ปัจจุบันหลายคนเริ่มใช้เครื่องมือ AI อย่าง ChatGPT, Copilot หรือระบบอัจฉริยะอื่นๆ มาช่วยในการทำงาน ไม่ว่าจะเป็นการสรุป วิเคราะห์ หรือแปลเอกสาร ซึ่งช่วยให้ทำงานได้รวดเร็วและมีประสิทธิภาพมากขึ้น

แต่อย่าลืมว่า ข้อมูลที่เราป้อนให้ระบบ AI อาจเสี่ยงต่อการรั่วไหล หรือถูกนำไปใช้ในทางที่ไม่เหมาะสม โดยเฉพาะหากข้อมูลนั้นตกไปอยู่ในมือของอาชญากรไซเบอร์ที่มักมองหาช่องโหว่เพื่อเข้าถึงข้อมูลสำคัญ

วันนี้ MIS News จะพาทุกคนมาดูกันว่า มีข้อมูลประเภทใดบ้างที่ไม่ควรป้อนลงในระบบ AI เพื่อป้องกันความเสี่ยงด้านความเป็นส่วนตัว

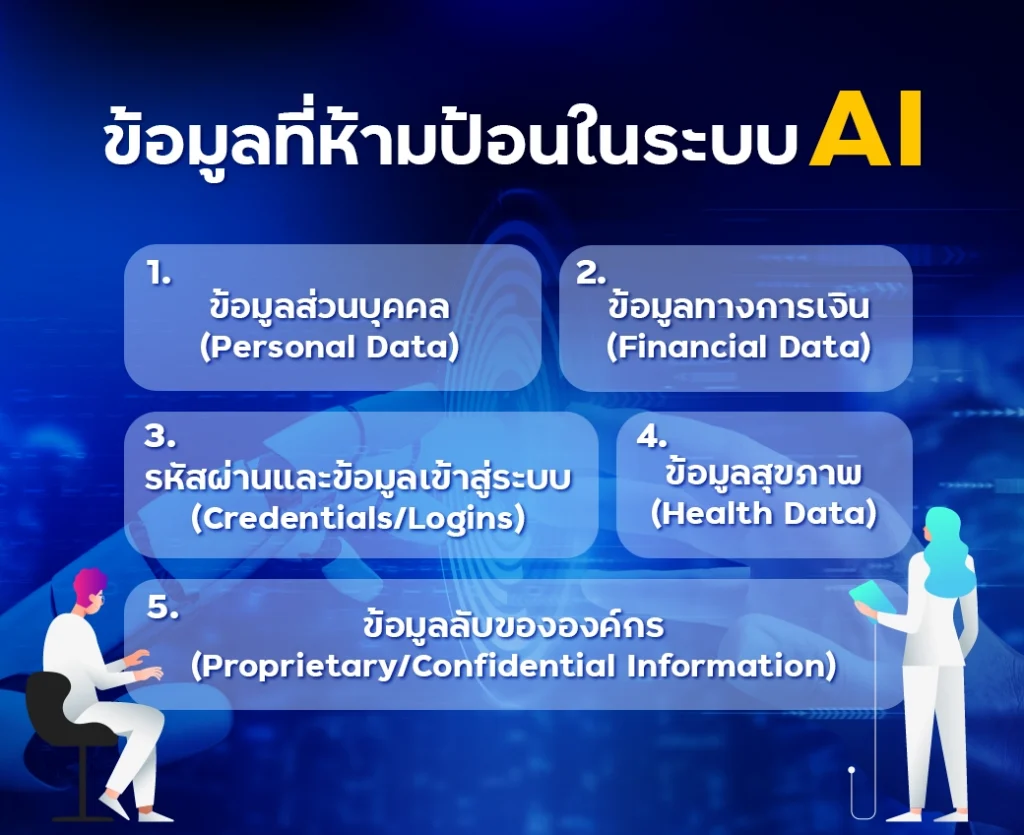

ข้อมูลที่ห้ามป้อนในระบบ AI

1. ข้อมูลส่วนบุคคล (Personal Data) ได้แก่ ชื่อ-นามสกุล, เบอร์โทรศัพท์, อีเมล, วันเกิด, เลขบัตรประชาชน, พาสปอร์ต, ที่อยู่ และข้อมูลระบุตัวตนอื่นๆ

ความเสี่ยง : หากข้อมูลพวกนี้รั่ว อาจถูกนำไปใช้สวมรอย เปิดบัญชีปลอม ทำธุรกรรมผิดกฎหมาย หรือโจรกรรมตัวตนในโลกออนไลน์

2. ข้อมูลทางการเงิน (Financial Data) เช่น เลขบัญชีธนาคาร, เลขบัตรเครดิต-เดบิต, รหัส CVV, PIN, รายได้เฉพาะเจาะจง หรือข้อมูลพอร์ตการลงทุน

ความเสี่ยง : แฮกเกอร์อาจใช้ข้อมูลพวกนี้ขโมยเงิน โอนเงินผิดกฎหมาย หรือก่อหนี้ผ่านบัตรและบัญชีของคุณได้

3. รหัสผ่านและข้อมูลเข้าสู่ระบบ (Credentials /Logins) รวมถึงรหัสผ่านทุกบัญชี, คำถามความปลอดภัย, รหัส OTP หรือ 2FA (Two-Factor Authentication)

ความเสี่ยง : หากรหัสผ่านรั่วเพียงชุดเดียว แฮคเกอร์อาจนำไปลองกับแอคเคาท์อื่นๆ เพื่อยึดแอคเคาท์ทั้งหมดได้

4. ข้อมูลสุขภาพ (Health Data) ตัวอย่างเช่น ประวัติรักษาพยาบาล, โรคร้ายแรง, ประวัติสุขภาพจิต หรือข้อมูลการใช้ยา

ความเสี่ยง : ข้อมูลเหล่านี้อาจถูกนำไปใช้เลือกปฏิบัติ เช่น ปฏิเสธประกัน หรือตัดสินการสมัครงาน และยังเสี่ยงต่อการถูกขายต่อในตลาดมืด

5. ข้อมูลลับขององค์กร (Proprietary /Confidential Information) ได้แก่ แผนธุรกิจ, กลยุทธ์การตลาด, รายชื่อลูกค้า, ข้อมูลทางการเงิน หรือโปรเจกต์สำคัญ

ความเสี่ยง : อาจถูกคู่แข่งใช้โจมตีทางธุรกิจ หรือสร้างความเสียหายต่อองค์กรโดยตรง

อย่าลืมว่า การใช้งาน AI ควรทำอย่างรอบคอบและมีสติ เพื่อปกป้องข้อมูลสำคัญและรักษาความเป็นส่วนตัวของเราให้ปลอดภัยอยู่เสมอค่ะ

ขอบคุณที่มาจาก : netkasystem